LM Studio یک ابزار متنباز (Open Source) است که به کاربران امکان میدهد مدلهای زبانی بزرگ (Large Language Model – LLMs) را به صورت محلی (روی سیستم خود) و حتی در حالت آفلاین (Offline) اجرا کنند. این پروژه برای متخصصانی طراحی شده که به دلایل امنیتی یا دسترسی محدود به اینترنت نمیتوانند از ابزارهای آنلاین استفاده کنند، اما همچنان نیاز به هوش مصنوعی پیشرفته دارند.

سایت رسمی پروژه: lmstudio.ai

1- از سایت زیر نسخه مناسب سیستم عامل تان را انتخاب کنید:

https://p30download.ir/fa/entry/112975/lm-studio

نرم افزار را مشابه سایر نرم افزارهای معمول نصب کنید.

2- بعد از نصب نرم افزار نیاز هست مدل هوش مصنوعی را دانلود کنید. از همین لینک بالا در قسمت (دانلود مدل ها) با توجه به سخت افزار رایانه مدلی را دانلود کنید.

3- مدل زبانی که دانلود کرده اید را از حالت فشرده خارج کنید.

4- در قسمت Run ویندوز عبارت زیر را وارد و Enter را بزنید.

%HOMEPATH%\.lmstudio\models

5- یک پوشه با نام lmstudio-community در مسیر بالا ایجاد کنید.

6- مدل زبانی که از حالت فشرده خارج شده شامل یک پوشه با نامی هست که به GGUF ختم میشود، پوشه مذکور را به درون پوشه lmstudio-community منتقل کنید.

توجه: اگر چند مدل را دانلود کرده اید به همین طریق پوشه سایر مدل ها را در کنار مدل فعلی درون پوشه lmstudio-community منتقل کنید.

» » توجه شود منظور از رم در توضیحات زیر Vram هست که مربوط به کارت گرافیک هست. طبق تجربه و توضیحات نرم افزار lm studio حداقل رم گرافیک ترجیحا باید 8 گیگ باشه تا بتونید تجربه نسبتا خوبی را از کار با این مدل های هوش مصنوعی آفلاین داشته باشید.

»» این توضیحات از قول کاربری در سایت git.ir جهت آگاهی از نحوه انتخاب مدل های مناسب با توجه به سیستم استفاده شده ارایه شده است :

برای محاسبه دقیق رم (RAM) و حافظه گرافیکی (VRAM) مورد نیاز برای اجرا(Inference) و بارگذاری (Loading) مدلهای هوش مصنوعی چقدر فضا نیاز دارید ؟ از این فرمول ساده استفاده کنید:

RAM/VRAM حجم مورد نیاز = (p × q ÷ 8) × 1.2

که در اون:

p : پارامتر های مدل

q : عدد کوانتایز مدل

عدد 1.2 هم مقداری خارج از فرمول اصلی و صرفا برای سربار سیستم و فریمورک و …

مثال:

برای اجرای مدل DeepSeek-R1 – Qwen3 8B اسم کاملش که تولینک دانلود هست به این صورته:

DeepSeek-R1-0528-Qwen3-8B-Q3_K_L.gguf

p=8

q=3

((8*3)/8)*1.2 = 3.6 گیگا بایت حافظه لازم دارید.

سیستمهای ضعیف یا معمولی (۴ تا ۸ گیگابایت رم)

اگر از یک لپتاپ یا سیستم خانگی معمولی استفاده میکنید، بهترین انتخاب شما مدلهای 1B تا 4B است.

این مدلها سبک هستند و معمولاً روی CPU هم اجرا میشوند (اغلب بهصورت کوانتایز شده).

برای کارهایی مثل:

در این سطح سختافزاری، مدلهای 7B تا 12B بهترین تعادل بین کیفیت پاسخ و مصرف منابع را ارائه میدهند.

این مدلها:

مدلهای 7B معمولاً نقطهی تعادل ایدهآل محسوب میشوند و 12B کیفیت بالاتری ارائه میدهد، البته با مصرف منابع بیشتر

در ادامه لیست مدلهای موجود برای استفاده در LM Studio (ترتیب از سبک تا قدرتمند) از سایت git.ir ارایه شده است:

مناسب برای لپتاپهای ضعیف یا شروع آشنایی با مدلهای هوش مصنوعی.

ترکیب خوب از کیفیت مناسب و مصرف منابع معقول.

اگر حداقل ۱۲–۱۶ گیگابایت RAM دارید، این مدل بسیار بهتر از مدلهای سبک عمل میکند.

برای کاربردهای معمولی و پاسخهای سریع گزینه قابلتوجهی است.

برای سیستمهای قوی با RAM ≥ 32 گیگابایت مناسب است.

اگر هدف شما استفاده تخصصی در حوزه کدنویسی و تحلیلهای سنگین باشد، این مدل مناسب است.

مدل های متنوع دیگه رو میتونید از لینک زیر ببینید. (این مدلها توسط کانال @ai_src در اپلیکیشن بله جمع آوری شده است.)

https://my.uupload.ir/f/dlmech/LLMs

بعد از نصب برنامه و کپی کردن هوش های مصنوعی در پوشه گفته شده، نوبت به چت با هوش مصنوعی افلاین میرسد.

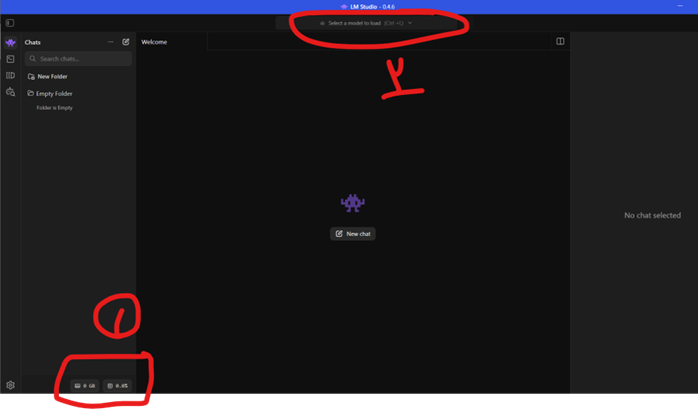

محیط چت به شکل زیر هست.

lm studio

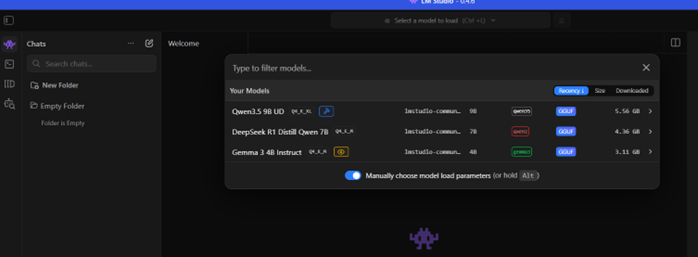

انتخاب یکی از مدل های هوش مصنوعی

lm studio

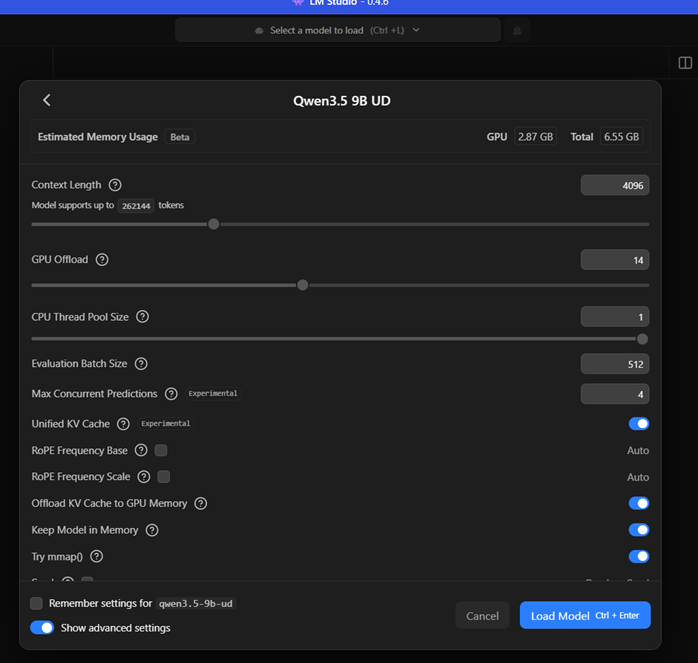

در شکل زیر مقدار حافظه در دسترس هوش مصنوعی، تعداد هسته گرافیک و همچنین تعداد رشته های سی پی یو مورد استفاده نمایش داده شده است.

در این مرحله میتونید با توجه به مدل هوش مصنوعی و سیستمتون این اعداد رو کم و زیاد کنید تا به مقدار بهینه برسید.

در انتها گزینه load model رو جهت ورود به صفحه چت بزنید.

lm studio

lm studio

در قسمت بعدی به راه اندازی LM studio روی لوکال سرور می پردازیم.

کارشناسی ارشد مکاترونیک دوستدار الکترونیک و دنیای دیجیتال http://mecha.ir

هنوز استفاده نکردم اما توضیحاتتون عالی، منون بابت زحمات با ارزشتان

عالی👍

سیسوگ با افتخار فضایی برای اشتراک گذاری دانش شماست. برای ما مقاله بنویسید.